本記事は、情報理論の基礎である「情報源符号化」のまとめ記事シリーズの第2章です。

「情報源符号化」のまとめ記事では、「エントロピー」から始まり「条件付きエントロピー」「相互情報量」「通信路容量」「平均誤り率」「情報速度」について解説していきます。

統一した例題を使用しますので、ご安心して学んでいただけます。

第2章では「条件付きエントロピー」に焦点を当て、

その定義や意味、具体的な計算方法について解説します。

前回の「エントロピー」について解説した記事は↓になります。

条件付きエントロピーとは?

条件付きエントロピーは、前回やったエントロピーと同じ考え方なのです。

通常のエントロピーでも確率を用いて求めましたが、

条件付きエントロピーは扱う確率が条件付き確率になります。

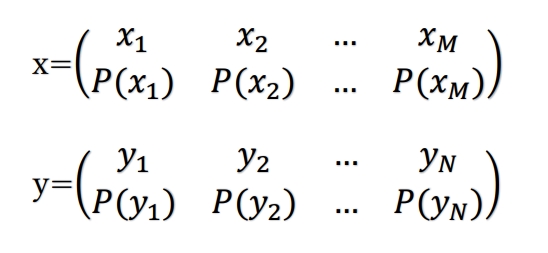

事象xi、事象yiの生起確率をP(xi)およびP(yj)で表すと、

それぞれ以下のように表すことができる。

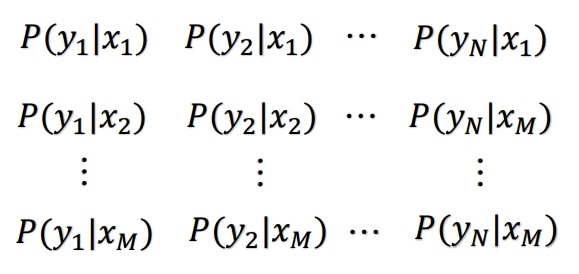

P(yj|xi) : xiが起こったときにyjが起こるとわかる時の条件付き確率

考えられる条件付き確率は、

以下のようになる。

(xが最大Mコ、yが最大Nコの場合)

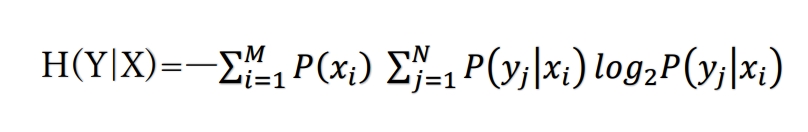

この条件付きエントロピーは以下の式で求めることができる。

XとYを入れ替えた、H(X|Y)も同様に考えられる。

[ビット/記号]

例えば、

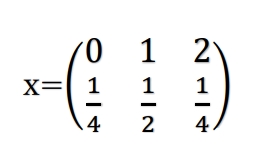

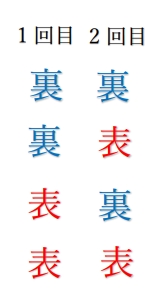

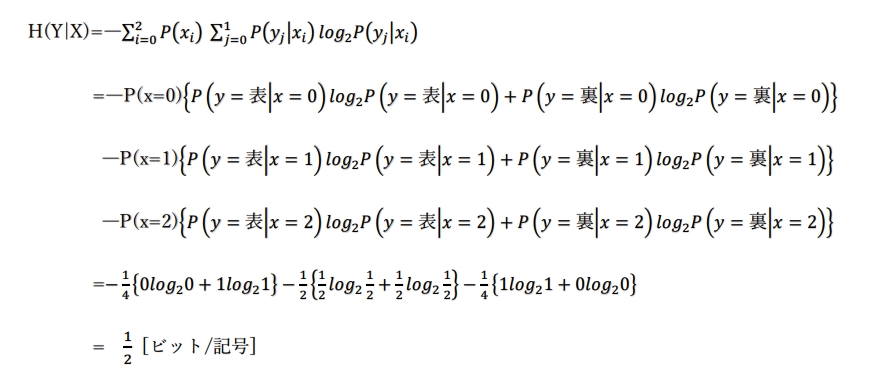

硬貨を2回投げたとき、表のでる回数をXとする。X=0,1,2

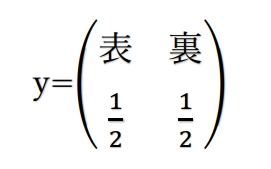

2回目に投げた硬貨が表か裏かを表す確率をYとする Y=表、裏

図で表すと以下のようになります。

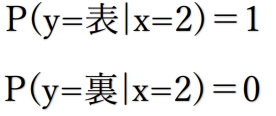

条件付き確率は以下のようになります。

表がでる回数が0回で、

2回目が表だった確率と2回目が裏だった確率

表がでる回数が1回で、

2回目が表だった確率と2回目が裏だった確率

表がでる回数が2回で、

2回目が表だった確率と2回目が裏だった確率

x起こったときにyが起こるとわかるときの

条件付きエントロピーは次のようになります。

〇単位の違い

エントロピーH(X) の単位:

[ビット/情報源記号]→情報源が発生する記号全体に対して平均情報量を表す。

条件付きエントロピーH(Y|X) の単位:

[ビット/記号]→条件を考慮した上での、1記号あたりの平均情報量を表す。

例題

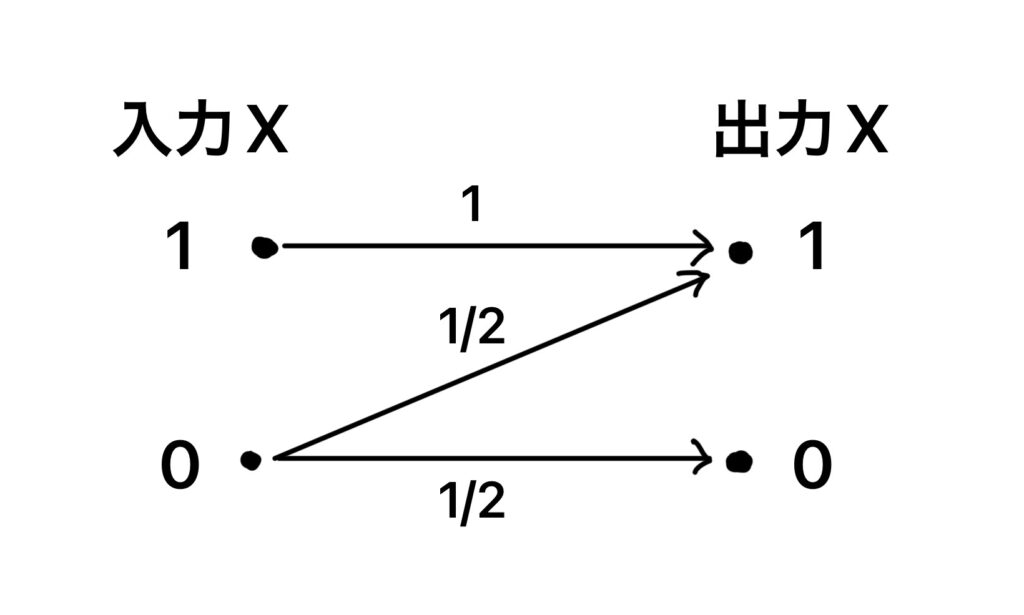

[例題]

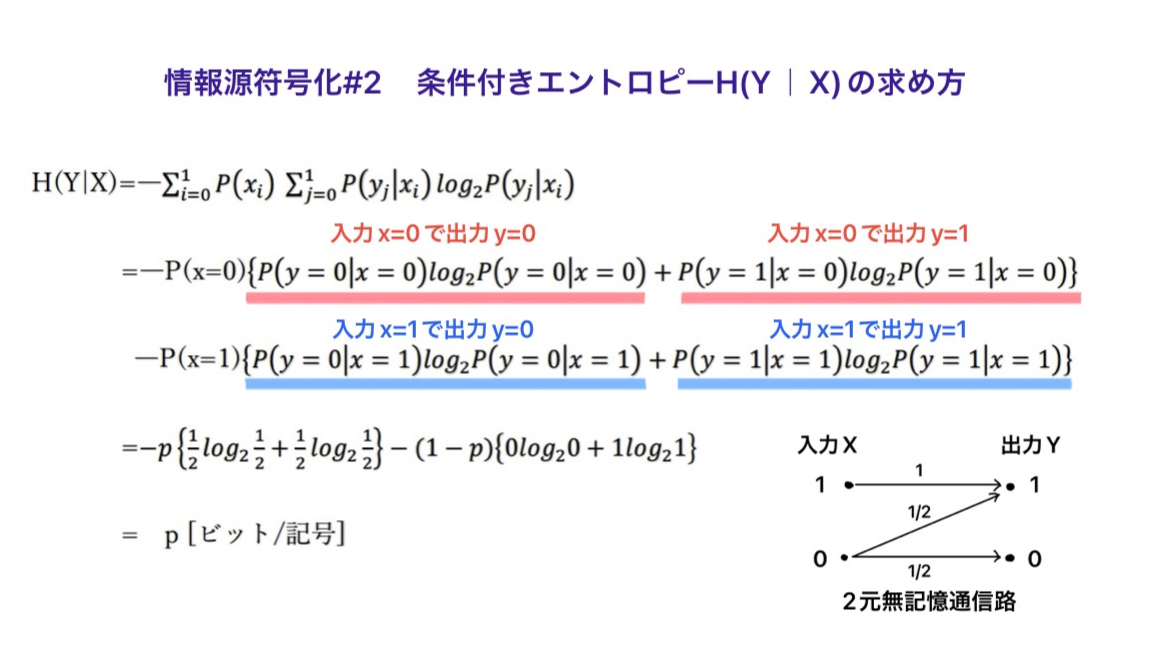

図のような2元無記憶通信路を考える。入力X,入力Yとし、いずれもアルファベット{0,1}上の確率変数であるとする。入力X=0となる確率をpとする。2元エントロピー関数h(α)=ーαlog2α ー (1ーα)log2(1ーα)を利用できる場合は、それを用いよ。

(1)エントロピーH(Y)を答えよ。 ←前回の記事#1で解説

(2)条件付きエントロピーH(Y|X)を答えよ。 ←今回はここ

(3)相互情報量I(X;Y)を答えよ。

(4)通信路容量C0とそれを実現するpの値をそれぞれ答えよ。

(5)2ビットの2元符号M={00,11}を考え、2つの符号語が1/2で生起する。

このとき、復号誤り率Pe(平均誤り率)を答えよ。

(6)(5)の2元符号の伝送速度R(情報速度)を答えよ。

引用:名古屋工業大学 2021年度 大学院工学研究科(博士前期課程)

専門試験問題 (情報工学系プログラム)

解答

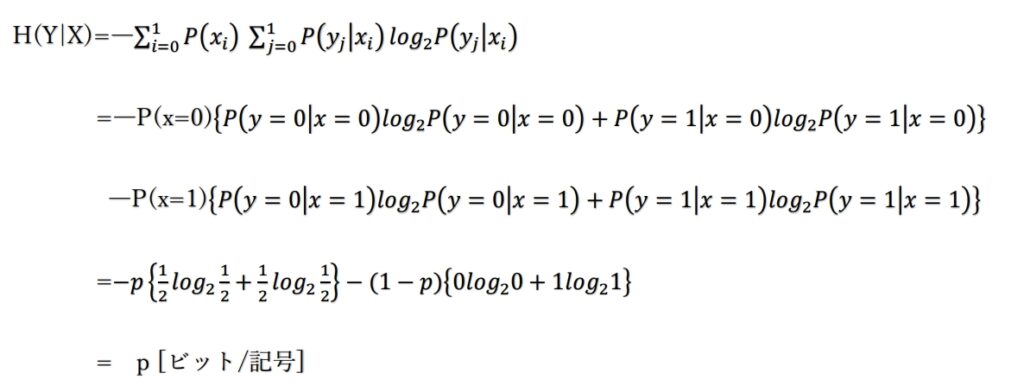

(2)条件付きエントロピーH(Y|X)を答えよ。

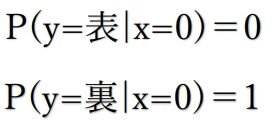

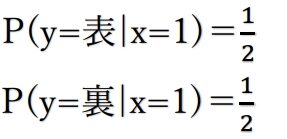

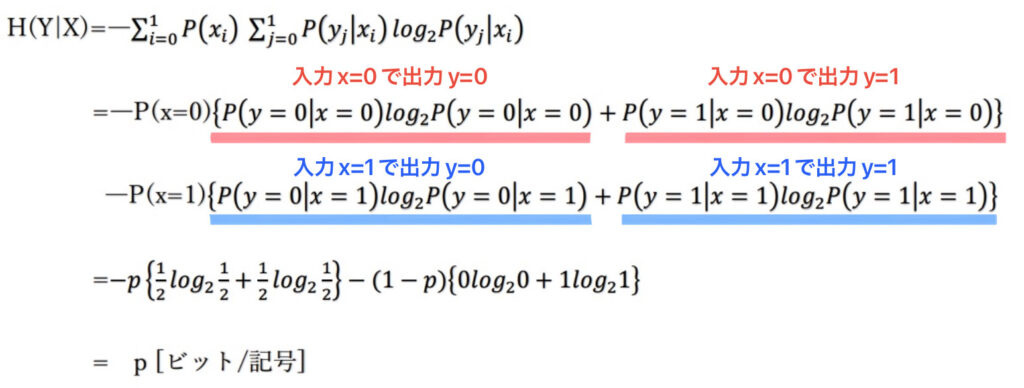

P(X=0)=p、 P(x=1)=1-p

P(Y=0|X=0)=1/2、P(Y=1|X=0)=1/2

P(Y=0|X=1)=0、P(Y=1|X=1)=1

答え:P[ビット/記号]

解説

P(X=0)=p、 P(x=1)=1-p は設問で指定されている。

P(Y=0|X=0)=1/2 :入力が0から出力が0だった時の条件付き確率

P(Y=1|X=0)=1/2 :入力が0から出力が1だった時の条件付き確率

P(Y=0|X=1)=0 :入力が1から出力が0だった時の条件付き確率

P(Y=1|X=1)=1 :入力が1から出力が1だった時の条件付き確率

以上を用いて、条件付きエントロピーH(Y|X)を求めると、

コメント